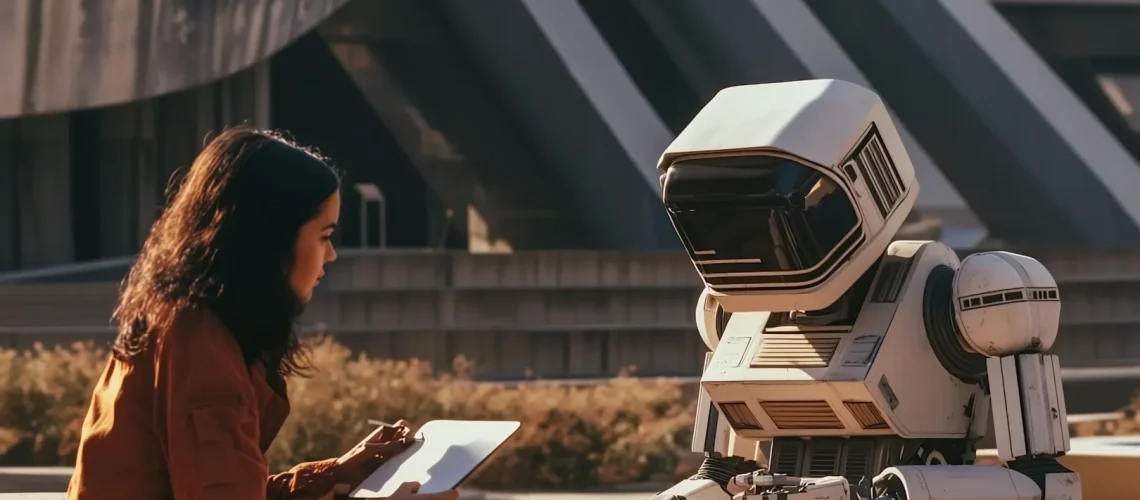

مع استمرار الذكاء الاصطناعي في إعادة تشكيل عالمنا، أصبحت أخلاقيات تصميم الذكاء الاصطناعي أكثر أهمية. ويمثل عام 2025 لحظة محورية حيث أنظمة الذكاء الاصطناعي تتكامل هذه التقنيات بشكل عميق مع الرعاية الصحية، والمالية، والنقل، وجوانب لا تُحصى من الحياة اليومية. وتُتيح هذه التطورات التكنولوجية إمكانيات غير مسبوقة ومسؤوليات لا تقل أهمية.

يتطلب التطور السريع لتقنيات الذكاء الاصطناعي دراسةً متأنيةً لتأثيرها المجتمعي. بدءًا من المركبات ذاتية القيادة التي تتخذ قراراتٍ سريعةً، وصولًا إلى أنظمة التوظيف المدعومة بالذكاء الاصطناعي التي تُقيّم المرشحين، يجب أن تتوافق هذه التقنيات مع القيم الإنسانية والحقوق والأعراف الاجتماعية. وتتجاوز العواقب المحتملة لأنظمة الذكاء الاصطناعي سيئة التصميم بكثير الأعطال التقنية، إذ قد تؤثر على حياة البشر وتُكرّس التفاوتات البنيوية.

يقف المطورون في طليعة هذه الحدود الأخلاقية. قراراتهم خلال مرحلتي التصميم والتنفيذ تُشكل بشكل مباشر كيفية تفاعل أنظمة الذكاء الاصطناعي مع حياة البشر وتأثيرها عليهم. وبصفتهم مهندسي هذه الأنظمة الذكية، المطورين يجب عليهم أن يضطلعوا بدورهم كأوصياء أخلاقيين، وأن يدرسوا بعناية آثار خياراتهم التصميمية في كل مرحلة من مراحل التطوير. سيؤثر الكود الذي يكتبونه اليوم على عدالة وشفافية ومساءلة مشهد الذكاء الاصطناعي في المستقبل.

فهم المبادئ الأخلاقية في تصميم الذكاء الاصطناعي

يعتمد الأساس الأخلاقي لتصميم الذكاء الاصطناعي على العديد من المبادئ المترابطة التي أصبحت ذات أهمية متزايدة مع اقترابنا من عام 2025. تعمل هذه المبادئ كحواجز للابتكار المسؤول مع حماية القيم والحقوق الإنسانية في عالم مدفوع بالذكاء الاصطناعي.

1. عدل

عدل يُعدّ الالتزام الأخلاقي مبدأً أساسيًا في تطوير الذكاء الاصطناعي. يجب أن تُقدّم أنظمة الذكاء الاصطناعي نتائج متسقة وغير متحيزة لجميع الفئات السكانية، مما يُلزم المطورين بتطبيق بروتوكولات اختبار دقيقة ومجموعات بيانات تدريبية متنوعة. على سبيل المثال، يجب أن يحافظ نظام التعرف على الوجه على معدلات دقة متساوية بغض النظر عن لون البشرة أو العمر أو الجنس.

2. الموثوقية والسلامة

تتطلب الموثوقية والسلامة أنظمة ذكاء اصطناعي تعمل بكفاءة في ظل ظروف متنوعة. ويشمل ذلك معالجة دقيقة للأخطاء، وآليات أمان ضد الأعطال، واختبارات شاملة في مختلف السيناريوهات. يجب أن تحافظ المركبة ذاتية القيادة على أداء ثابت في مختلف الظروف الجوية وحالات المرور غير المتوقعة.

3. الخصوصية والأمن

الخصوصية والأمن تحمي الاعتبارات بيانات المستخدم من خلال التشفير والتخزين الآمن والتحكم في الوصول. ينبغي أن تجمع أنظمة الذكاء الاصطناعي البيانات الضرورية فقط، وأن تطبق ضمانات قوية ضد الوصول غير المصرح به أو الاختراقات. ويجب على تطبيقات الذكاء الاصطناعي في مجال الرعاية الصحية، على وجه الخصوص، الحفاظ على السرية التامة لسجلات المرضى مع تقديم تشخيصات دقيقة.

4. الشمولية

يضمن الشمول خدمة تقنيات الذكاء الاصطناعي لجميع الفئات السكانية على قدم المساواة. وهذا يعني تصميم واجهات سهلة الاستخدام للمستخدمين ذوي القدرات والخلفيات الثقافية والخبرات التقنية المختلفة. ينبغي أن تفهم أنظمة التعرف على الصوت اللهجات وأنماط الكلام المتنوعة، بينما يجب أن تستوعب الأدوات التعليمية المدعومة بالذكاء الاصطناعي أنماط التعلم المتنوعة.

5. شفافية

تتطلب الشفافية أن تشرح أنظمة الذكاء الاصطناعي عمليات اتخاذ القرارات بعبارات مفهومة. ينبغي أن يعرف المستخدمون سبب اتخاذ الذكاء الاصطناعي لتوصيات أو قرارات محددة. وينبغي أن يوضح نظام الذكاء الاصطناعي لموافقة القروض العوامل المؤثرة في قراراته.

6. المسائلة

تُرسي المساءلة مسؤولية واضحة عن نتائج الذكاء الاصطناعي. يجب على المطورين والمؤسسات تتبع آثار أنظمتهم، ومعالجة العواقب غير المقصودة، والحفاظ على آليات لمعالجة المشاكل عند حدوثها. ويشمل ذلك عمليات تدقيق منتظمة، وتقييمات للأثر، وتسلسلات مسؤولية موثقة للقرارات التي يُحركها الذكاء الاصطناعي.

دمج الأطر الأخلاقية في عمليات تطوير الذكاء الاصطناعي

يتطلب دمج الأطر الأخلاقية في تطوير الذكاء الاصطناعي اتباع مناهج منهجية في كل مرحلة من مراحل عملية التطوير. يجب على المؤسسات وضع بروتوكولات وإرشادات واضحة تتوافق مع المعايير الأخلاقية المعترف بها، مع الحفاظ على قدرتها على التكيف مع التحديات الناشئة.

الأطر الراسخة

يمكن للمطورين اعتماد أطر عمل راسخة، مثل التصميم المتوافق مع الأخلاقيات لمعهد مهندسي الكهرباء والإلكترونيات (IEEE) أو المبادئ التوجيهية الأخلاقية للذكاء الاصطناعي الموثوق به للمفوضية الأوروبية. توفر هذه الأطر منهجيات منظمة لتضمين الاعتبارات الأخلاقية طوال عملية التطوير، بدءًا من المفهوم الأولي وحتى النشر والصيانة.

مكاتب أخلاقية مخصصة

تتضمن إحدى الاستراتيجيات التنظيمية الحاسمة إنشاء أخلاقيات مخصصة لمكاتب أو لجان الذكاء الاصطناعي. تعمل هذه الوحدات المتخصصة كمراكز رئيسية لحوكمة الذكاء الاصطناعي المسؤولة، وتطوير السياسات، ومراجعة مشاريع الذكاء الاصطناعي، وضمان الامتثال للمبادئ التوجيهية الأخلاقية. وقد طبقت شركات مثل مايكروسوفت وجوجل مثل هذه الهياكل، مما يُثبت فعاليتها في الحفاظ على الرقابة الأخلاقية.

أدوات المراقبة المستمرة

تؤدي أدوات المراقبة المستمرة دورًا حيويًا في الكشف عن المخاطر الأخلاقية المحتملة في الأنظمة المُستخدمة. ويمكن لهذه الأدوات تتبع السلوك الخوارزمي، وتحديد النتائج غير المتوقعة، والتنبؤ بالتحيزات المحتملة آنيًا. وتستخدم أنظمة المراقبة المتقدمة مقاييس لقياس العدالة والشفافية والمساءلة عبر مختلف فئات المستخدمين.

التعاون متعدد الوظائف

يُعدّ التعاون بين مختلف التخصصات حجر الزاوية في تطوير الذكاء الاصطناعي الأخلاقي. ينبغي أن تضمّ الفرق خبراء في الأخلاقيات والقانون وعلماء اجتماع وممثلين عن المجتمع، ممن يمكنهم تقديم وجهات نظر متنوعة حول التأثيرات المحتملة. يُساعد هذا النهج التعاوني على تحديد الجوانب غير المهمة ويضمن دراسة شاملة للآثار الأخلاقية.

برامج التدريب المنتظمة

تُبقي برامج التدريب المنتظمة المطورين على اطلاع دائم بالتحديات الأخلاقية الناشئة والمتطلبات التنظيمية المتطورة. ينبغي أن تشمل هذه البرامج دراسات حالة عملية، وورش عمل عملية، وتمارين تعليمية قائمة على السيناريوهات. يجب على المؤسسات الاستثمار في التعليم المستمر لبناء فرق قادرة على معالجة الاعتبارات الأخلاقية المعقدة في تطوير الذكاء الاصطناعي.

معالجة التحيز والشمول والتمييز في أنظمة الذكاء الاصطناعي

قد تكون أنظمة الذكاء الاصطناعي متحيزة لأنها تتعلم من بيانات قد تعكس أوجه عدم المساواة والتحيزات القائمة في المجتمع. يحدث هذا التحيز عندما لا تُمثل مجموعات معينة تمثيلاً كافياً في بيانات التدريب، أو عندما تحتوي البيانات نفسها على تحيزات. على سبيل المثال، في عام ٢٠٢٤، أظهر نظام ذكاء اصطناعي رئيسي للرعاية الصحية اختلافات كبيرة في التشخيصات بين مختلف المجموعات العرقية، لأن بيانات التدريب الخاصة به جاءت في الغالب من مجموعات سكانية ذات خصائص متشابهة.

معالجة التحيز في تطوير الذكاء الاصطناعي

لمواجهة هذه المشكلة، سيحتاج المطورون بحلول عام ٢٠٢٥ إلى وضع بروتوكولات فعّالة للكشف عن التحيز أثناء جمع البيانات وتدريب النماذج. ويشمل ذلك:

- تحليل التركيبة السكانية لمجموعات بيانات التدريب بشكل شامل

- استخدام الأساليب الإحصائية لكشف التحيزات الخفية

- دمج مصادر البيانات المتنوعة

يمكن للأدوات التي تكتشف التحيز تلقائيًا وتقيس العدالة أن تساعد في تحديد الثغرات في التمثيل وأنماط التمييز المحتملة قبل وضع نظام الذكاء الاصطناعي موضع الاستخدام.

تصميم أنظمة الذكاء الاصطناعي الشاملة

يتطلب إنشاء أنظمة ذكاء اصطناعي شاملة دراسةً متأنيةً لكيفية تصميم الواجهات وكيفية عمل الوظائف. على سبيل المثال:

- يجب أن تكون أنظمة التعرف على الصوت قادرة على فهم اللهجات المختلفة وطرق التحدث بدقة.

- يجب أن يعمل الذكاء الاصطناعي البصري بشكل متسق بغض النظر عن لون بشرة الشخص أو ملامح وجهه.

يعد مشروع Microsoft Seeing AI مثالاً للتصميم الشامل من خلال تقديم ميزات مساعدة بصرية شاملة للمستخدمين الذين يعانون من درجات متفاوتة من ضعف البصر.

التعلم من أخطاء الماضي

وتظهر الحوادث الماضية النتائج السلبية التي يمكن أن تنشأ عن إهمال هذه العوامل:

- في عام 2023، حدد نظام التعرف على الوجه واسع الاستخدام بشكل خاطئ النساء ذوات البشرة الملونة بمعدلات أعلى بنسبة 34% من المجموعات الديموغرافية الأخرى، مما أدى إلى انتهاكات خطيرة للخصوصية وتحديدات غير صحيحة.

- أظهرت أداة توظيف آلية تحيزًا كبيرًا بين الجنسين من خلال منح تقييمات أقل للسير الذاتية التي تضمنت مصطلحات مرتبطة بالكليات النسائية أو الأنشطة المرتبطة عادة بالإناث.

ضمان العدالة من خلال الاختبار وردود الفعل

لضمان العدالة، يجب اختبار أنظمة الذكاء الاصطناعي بدقة مع مجموعات متنوعة من المستخدمين. وينبغي مراعاة آراء المجتمعات المتأثرة بالتقنية طوال عملية التطوير. ويمكن أن تساعد عمليات التدقيق المنتظمة باستخدام أطر الاختبار التقاطعي في تحديد نقاط التمييز المحتملة في عمليات صنع القرار في النظام، وضمان أخلاقيات الذكاء الاصطناعي.

توثيق جهود التخفيف من التحيز

يتعين على المطورين الحفاظ على ممارسات توثيق واضحة تتبع جهودهم الرامية إلى تقليل التحيز والنتائج الناجمة عن تلك الإجراءات وضمان أخلاقيات الذكاء الاصطناعي.

خاتمة

مع اقترابنا من عام ٢٠٢٥، يُعدّ دمج الاعتبارات الأخلاقية في تطوير الذكاء الاصطناعي أمرًا بالغ الأهمية لتحقيق الابتكار المسؤول. ويتطلب النمو السريع لتقنيات الذكاء الاصطناعي من المطورين الاضطلاع بدور الحُرّاس الأخلاقيين، مُدمجين المبادئ الأخلاقية طوال عملية التطوير بأكملها.

في المستقبل، يجب أن نواصل التزامنا بتصميم ذكاء اصطناعي أخلاقي - بدءًا من الفكرة الأولية وحتى النشر والصيانة المستمرة. ينبغي على المطورين إعطاء الأولوية للإنصاف والشفافية والمساءلة، مع العمل بنشاط على القضاء على التحيزات وتعزيز الشمولية. هذه المبادئ ليست مجرد اقتراحات، بل هي متطلبات أساسية لبناء أنظمة ذكاء اصطناعي تُفيد البشرية حقًا.

إن التحديات التي يواجهها مشهد الذكاء الاصطناعي في عام ٢٠٢٥ غير مسبوقة. فكل سطر من التعليمات البرمجية وخيار تصميم سيؤثر على كيفية تفاعل البشر مع الذكاء الاصطناعي مستقبلًا. ومن خلال تبني ممارسات أخلاقية استباقية اليوم، يمكن للمطورين إنشاء أنظمة ذكاء اصطناعي تُعزز القدرات البشرية مع حماية حقوق الأفراد وقيم المجتمع. يجب علينا دمج الأخلاقيات في تطوير الذكاء الاصطناعي الآن وليس لاحقًا.

للمنظمات التي تعمل على تطوير مواقع الإنترنت في أبوظبي، تنطبق هذه المبادئ نفسها: يتطلب بناء حلول رقمية أخلاقية، متمحورة حول الإنسان، جهدًا واعيًا منذ المراحل الأولى. لا يعتمد مستقبل الذكاء الاصطناعي - وجميع التقنيات - على قدراته التقنية فحسب، بل يعتمد أيضًا على قدرتنا على ضمان خدمته للصالح العام.